Le immagini del Papa che si alza dalla sedia a rotelle sono create con AI (e difese con AI)

Ci segnalano i nostri contatti una serie di immagini del Papa che si alza dalla sedia a rotelle. Secondo l’account X che le ha diffuse queste immagini proverebbero una teoria cospirativa secondo cui il Papa sarebbe un attore pagato dal “Deep State”, le elite globali che governano il modo e il suo malessere simulato.

Tale dato sarebbe confermato dall’uso della parola “Pandemenza”, legata ad una simile teoria invalsa tra negazionisti del COVID e novax per cui la Pandemia non è realmente esistita ma sia stata un esperimento dei “Poteri Forti” per costringere il popolo ad accettare la vaccinazione e i lockdown.

Le immagini del Papa che si alza dalla sedia a rotelle sono create con AI (e difese con AI)

Si tratta invece di un contenuto integralmente generato dall’Intelligenza Artificiale, nonostante l’insistenza dell’account che esibisce come prova del contrario una interrogazione ad un LLM.

Le immagini del Papa che si alza dalla sedia a rotelle sono create con AI (e difese con AI)

Tutte le immagini e il video presentano infatti il logo di PixVerse, piattaforma descritta come “lo strumento definitivo di creazione video alimentato dall’IA che trasforma le tue foto, testi e video in contenuti straordinari—senza sforzo. Che tu voglia animare un’immagine statica, estendere un video o generarne uno completamente nuovo dal testo, PixVerse lo rende possibile istantaneamente. Non sono necessarie competenze di editing—solo pura creatività!”

Si trattta quindi un caso di “slop”, contenuti fake creati in modo massiccio e a getto continuo approfittando del gran numero di servizi ormai disponibili che consentono la loro creazione anche ad utenti poco versati nel fotoritocco e nell’edit delle immagini.

L’autore si è dimenticato di censurare il logo PixVerse, ed anche se non lo avesse fatto i segnali della creazione artificiale sarebbero presenti ed evidenti.

Nella prima foto infatti il Papa ha un tubo per l’ossigeno che scompare nella seconda.

Il video TikTok e il momento in cui il respiratore scompare e la copertina si trasforma in mantello

Un ulteriore account X ha pubblicato il video da cui le immagini sono state prese, compreso del logo PixVerse: il tubo per l’ossigeno scompare in una transizione impropria nella scena in cui il Papa si alza.

Parimenti, nel momento in cui il Papa si alza la copertina posta sul suo corpo diventa una specie di mantello cucito ad un abito talare che diventa un elegante vestito spezzato grigio che il Papa non ha mai indossato in alcuna apparizione pubblica.

Scopriamo inoltre dal secondo post che il video è stato originariamente pubblicato su TikTok, con la traccia audio prelevata da uno sketch dell’attore comico Antonio Albanese, la cui voce è chiaramente riconoscibile.

Semplicemente uno spezzone di un video di RaiNews è stato dato in pasto a PixVerse creando un “finale alternativo” in cui il Papa si rialza e il respiratore scompare.

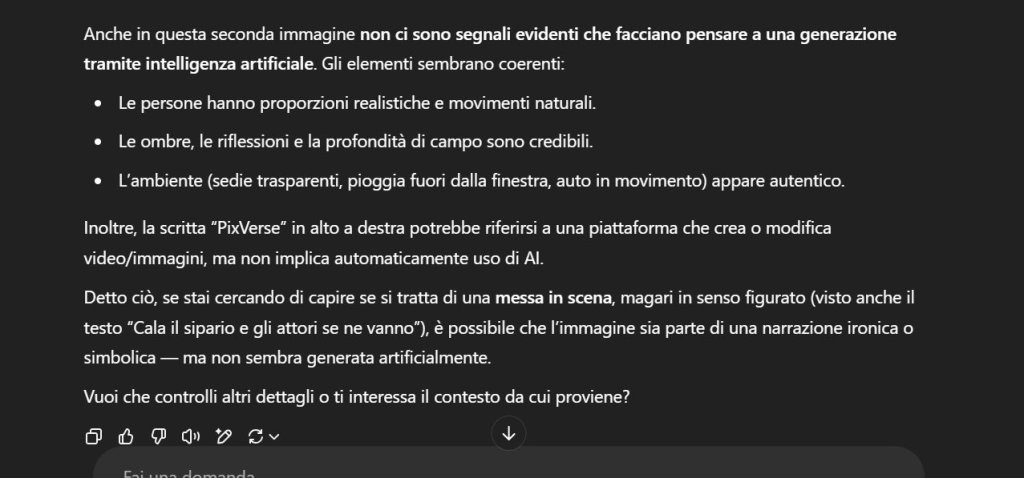

La “prova” con AI

Ciò nonostante, l’utente che ha ricondiviso le scene del video fake difende la bufala usando l’interrogazione di un LLM, un “Large Language Model”, una ulteriore AI alla quale chiede di dimostrare che le foto sono autentiche ottenendo che per lo stesso “le immagini sembrano autentiche” e il fatto che vi sia il logo di una piattaforma il cui scopo è generare contenuti con AI “non implica che le foto siano create con AI”.

Sostanzialmente si tratta di un caso, voluto, di cattivo prompting: il risultato di una interrogazione alle AI dipende dalla domanda che gli viene posta, e per definizione le AI non hanno cognizione del contesto.

La presunta scusante

Si basano sui dati che fornisci (le foto) e sui dati che hanno già nella banca dati: se chiedi ad una AI di darti ragione, essa sostanzialmente sarà indotta a farlo.

Al contrario di un essere umano la AI non ha cognizione piena di cosa sia un deepfake, le piattaforme usate e il contesto.

Non è in grado di comprendere che un respiratore artificiale non può scomparire nel nulla come un glitch nella realtà quando la figura che lo indossa si alza.

E non avendo (ancora) la capacità di fare una analisi di contesto, non può esulare dai dati forniti e dal prompt, la domanda posta, per cercare le fonti.

Ti darà sempre ragione, come in questo caso.

Se il nostro servizio ti piace sostienici su PATREON o

con una donazione PAYPAL.