Il “corpo del detenuto Assange” ci mette in guardia dai rischi delle AI

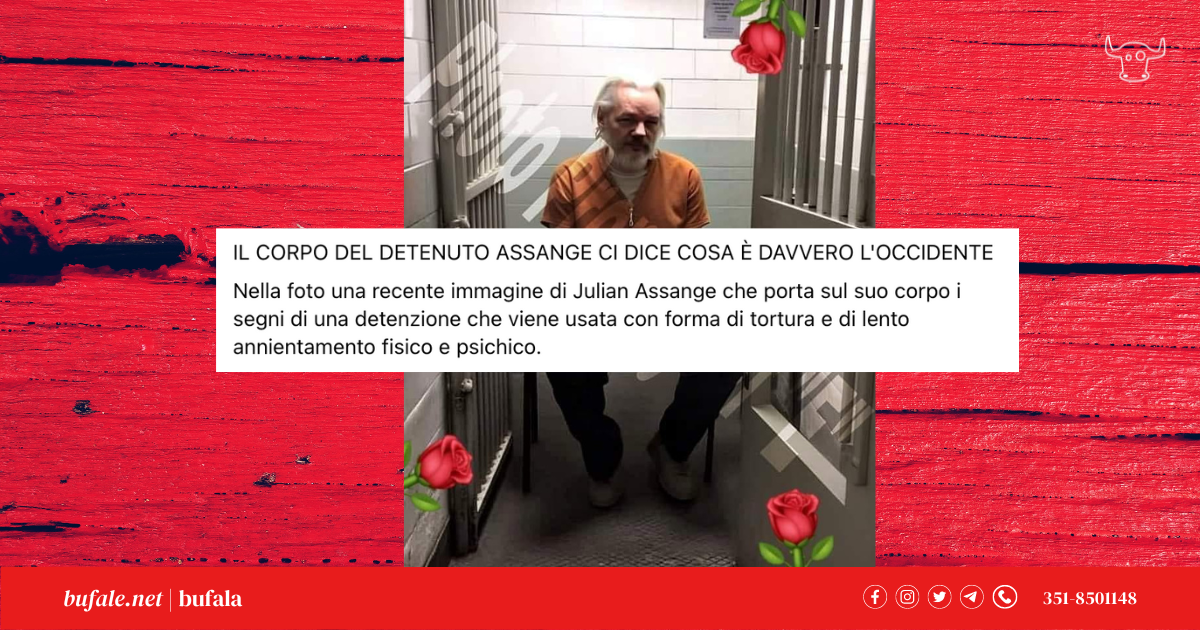

Il “corpo del detenuto Assange” ci mette in guardia dai rischi delle AI. Questo è quanto ci dimostra il caso di un post con una foto di Julian Assange, giornalista noto per il caso Wikileaks di cui ci siamo occupati più volte.

Il “corpo del detenuto Assange” ci mette in guardia dai rischi delle AI

Ma in questo caso non è la drammatica situazione di Julian Assange l’oggetto della discussione, ma come delle foto create con AI, intelligenza artificiale, siano diventate l’ennesimo caso di “Vero più vero del vero”.

Il “corpo del detenuto Assange” ci mette in guardia dai rischi delle AI

Sono tempi difficili per il fact checking: le bufale, un tempo narrazione perlopiù orale, eredi delle “Leggende Metropolitane” dei tempi andati, ora possono ricevere una nuova realtà.

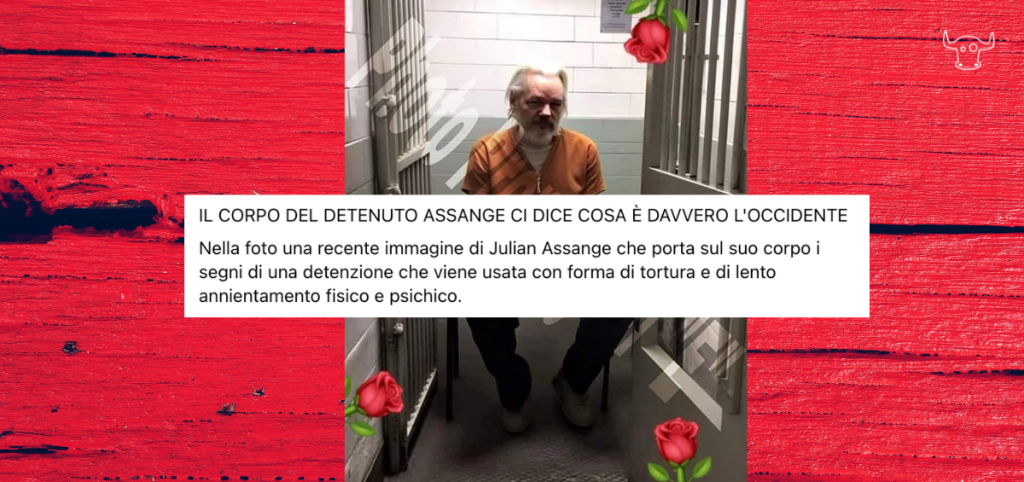

Viviamo in un mondo in cui è possibile chiedere a ChatGPT di scrivere un testo convincente, e con qualche aggiustamento farsi correggere una mail di scam, ad esempio ottenendo un “template” in tutte le lingue parlate da ChatGPT per convincere un utente a cliccare su un link per leggere di ipotetiche “Spese doganali”.

Esempio di mail generata con ChatGPT che potrebbe essere usata sia per scopi benevoli che malevoli

Ma anche in cui è possibile chiedere ad una AI di creare una “foto del Papa che drippa” e ottenere una foto del Papa vestito da Trapper che finisce sui social condivisa da persone che spergiurano sulla sua veridicità

La foto del “Papa che Drippa”

La combinazione dei due fattori può addirittura creare delle “non persone”: ci sono già tracce di legioni di troll organizzate munite di volti creati al computer e contenuti creati elettronicamente, o addirittura dei “falsi giornalisti più veri del vero”, i filorussi quanto inesistenti Vladimir Bondarenko e Irina Kerimova e gli “immortali fratelli Sasha e Masha”, utenti facenti capo ad un account che contiene solo foto create con AI e contenuti aggressivi verso l’Occidente e favorevoli a Putin.

Una foto di Julian Assange creata con AI non è un fattore neutro: sposta il consenso, crea una realtà diversa, crea un “falso più vero del vero” che peraltro viene rinforzato con le armi del “Non è vero ma è una raffigurazione simbolica del vero quindi io condivido”.

Le origini della fake news

L’immagine è stata chiaramente creata con AI e diffusa inizialmente su Twitter, assieme ad una seconda foto che ritrae il volto sofferente di Assange (sempre creato proceduralmente).

Di lì la foto è arrivata sui social, assieme a frammenti delle interviste ai congiunti del giornalista, da noi linkate sui precedenti articoli.

Il fatto che le foto siano un falso è una espressa confessione del loro autore, che ha giustificato l’azione con le seguenti parole

Sono state create per evocare una risposta di pancia e rappresentare accuratamente quello che il pubblico non può vedere. Ritengo importante dare alla sofferenza di Julian un volto umano, quello che l’Intelligenza Collettiva vuole cancellare

Nonché dei parenti di Assange.

La fake ha però immediatamente suscitato una discussione: possiamo concordare col parere riportato da Bild: aver bisogno di creare una falsità per diffondere la verità rende quella verità meno ricevibile e credibile.

Una “bufala per una buona causa” resta una bufala, e priva di credibilità ogni discussione sul tema.

Aprendo peraltro alla possibilità che altri autori di fake news, senza lo scudo “etico” delle buone intenzioni potranno usare gli stessi strumenti per creare un “falso più vero del vero”.

Conclusione

La foto del “corpo del detenuto Assange” è una fake news autoconfessa.

Se il nostro servizio ti piace sostienici su PATREON o

con una donazione PAYPAL.